Page 118 - 2025年第56卷第10期

P. 118

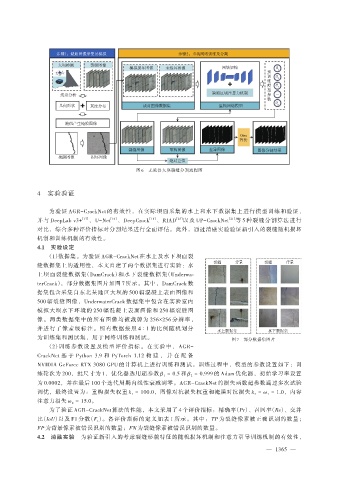

图 6 无监督大坝裂缝分割流程图

4 实验验证

为验证 AGR-CrackNet 的有效性,在实际坝面采集的水上和水下数据集上进行模型训练和验证,

[17] [16] [18] [25] [21]

并与 DeepLab v3+ 、U-Net 、DeepCrack 、RIAD 以及 UP-CrackNet 等 5 种裂缝分割算法进行

对比,综合多种评价指标对分割结果进行全面评估。此外,通过消融实验验证新引入的裂缝随机损坏

机制和训练机制的有效性。

4.1 实验设定

(1)数据集。为验证 AGR-CrackNet 在水上及水下坝面裂

缝数据集上的适用性,本文自建了两个数据集进行实验:水

上坝面裂缝数据集(DamCrack)和水下裂缝数据集(Underwa⁃

terCrack),部分数据集图片如图 7 所示。其中,DamCrack 数

据集包含采集自东北某地区大坝的 500 幅混凝土表面图像和

500 幅裂缝图像,UnderwaterCrack 数据集中包含在实验室内

模拟大坝水下环境的 250 幅混凝土表面图像和 250 幅裂缝图

像。两类数据集中的所有图像均被裁剪为 256×256 分辨率,

并进行了像素级标注。所有数据按照 4∶1 的比例随机划分

为训练集和测试集,用于网络训练和测试。 图 7 部分数据集图片

(2)训练参数设置及模型评价指标。在实验中,AGR-

CrackNet 基 于 Python 3.9 和 PyTorch 1.12 构 建 , 并 在 配 备

NVIDIA GeForce RTX 3080 GPU 的计算机上进行训练和测试。训练过程中,模型的参数设置如下:训

练轮次为 200,批尺寸为 1,优化器选用超参数 β 1 = 0.5 和 β 2 = 0.999 的 Adam 优化器,初始学习率设置

为 0.0002,并在最后 100 个迭代周期内线性衰减到零。AGR-CrackNet 的损失函数超参数通过多次试验

调优,最终设置为:重构损失权重 k 1 = 100.0,图像对抗损失权重和掩膜对抗损失 k 2 = ω 1 = 1.0,内容

注意力损失 ω 2 = 15.0。

为了验证 AGR-CrackNet 算法的性能,本文采用了 4 个评价指标:精确率(Pr)、召回率(Re)、交并

比(IoU)以及 F1 分数(F )。各评价指标的定义如表 1 所示。其中:TP 为裂缝像素被正确识别的数量;

1

FP 为背景像素被错误识别的数量;FN 为裂缝像素被错误识别的数量。

4.2 消融实验 为验证新引入的考虑裂缝形貌特征的随机损坏机制和注意力引导训练机制的有效性,

— 1365 —