Page 111 - 2024年第55卷第7期

P. 111

用信息的影响。

受水电机组自身工作环境影响,在信号处理过程中将不可避免会有背景噪声干扰。因此,需要一

种抗噪性能良好的特征提取工具。熵作为非线性动力学参数能够衡量信号的不确定性与复杂度,广泛

应用于故障特征提取方面 [9 - 11] 。与传统熵测度方法不同,文献[12]所采用的多尺度样本熵(Multiscale

SampleEntropy ,MSE)在熵测度时不需要估计信号概率密度函数,具有更高的计算效率,但 MSE存在

窗口长度选择困难、鲁棒性差等问题。为克服这些问题,文献[ 13]在 MSE基础上引入时移操作,将

数据集分解成不同尺度和时间延迟的子序列,然后计算每个子序列下的样本熵( SampleEntropy,SE),

更好地反映出时序数据的局部特征与时间演化规律。以此方法提取出不同频域层次上的特征熵,并用

于故障特征分类。

故障特征分类的本质是将故障信息输入到分类器,识别其故障类型。近年来,以机器学习为代表

的人工智能技术正逐渐被应用于故障诊断领域。例如:鲸鱼优化算法 [14] 、卷积神经网络 [15] 、支持向

量机 [16] 、遗传算法 [17] 等。但是上述智能算法存在对参数敏感性高,收敛速度慢、容易陷入局部最优

等问题。而鱼鹰算法( ospreyoptimizationalgorithm,OOA) [18] 作为一种群体智能优化算法,参数控制较

少,且收敛速度快。文献[19]将 OOA应用于电力系统的经济负荷调度问题上,并通过优化后的策略

实现了每台机组在各种负载需求下产生最佳功率,验证了其在解决实际问题方面的可行性和有效性。

同时,双向长短时记忆网络( Bi - directionalLong - ShortTerm Memory,BiLSTM)拥有强大时序序列学习

能力,使得该 网 络 在 处 理非线 性关 系、分 类 等问题上表 现出 色 [20] 。本 文 基 于两 种算 法的 优点,将

OOA和 BiLSTM结合,同时在 OOA算法中引入 Circle混沌映射与高斯随机游走策略以增强算法的全局

搜索能力,避免陷入局部最优解。

针对传 统 故 障 特 征 分 类 模 型 难 以 提 取 强 噪 声 下 的 故 障 信 号 特 征 这 一 难 题, 本 文 提 出 一 种

CEEMDAN - TSMSE结合 IOOA - BiLSTM的故障诊断模型。将 CEEMDAN与 TSMSE相结合,提取信号特

征,并以提取的特征向量作为 IOOA - BiLSTM 的输入,实现特征分类,最后与多组故障诊断模型进行

对比。结果表明,本文所提方法在水电机组故障诊断领域具有良好的效果。

2 理论基础

2.1 CEEMDAN算法 CEEMDAN通过分步加入白噪声的方式缓解了 EEMD算法中存在的模态混叠

现象,并且克服了 EEMD算法的不完整性以及依靠增大试验次数来降低重构误差的问题,使分解更具

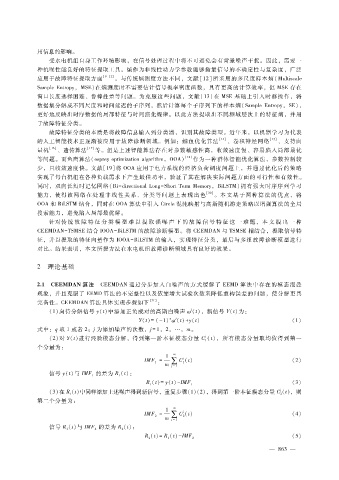

完备性。CEEMDAN算法具体实现步骤如下 [21] :

j

( 1)向待分解信号 y(t)中添加正负成对的高斯白噪声 ω(t),新信号 Y(t)为:

j

q

Y(t) =( - 1)ω(t) + y(t) (1)

式中:q取 1或者 2;j为添加噪声的次数,j = 1,2,…,m。

j

( 2)对 Y(t)进行经验模态分解,得到第一阶本征模态分量 C(t),所有模态分量取均值得到第一

1

个分量为:

1 m

j

IMF = ∑ C(t) (2)

1

1

m j =1

信号 y(t)与 IMF 的差为 R(t):

1

1

R(t) =y(t) - IMF (3)

1 1

j

(3)在 R(t)中同样添加上述噪声得到新信号,重复步骤(1)(2),得到第一阶本征模态分量 C(t),则

1

2

第二个分量为:

1 m

j

IMF = ∑ C(t) (4)

2 2

m j =1

信号 R(t)与 IMF 的差为 R(t):

2

2

1

R(t) =R(t) - IMF (5)

2 1 2

— 8 6 3 —